Sistemas Multi-Agente en n8n: Guía Completa para Crear Agentes IA Autónomos [2026]

Aprende a construir sistemas multi-agente con n8n, Flowise y Qdrant. Tutorial paso a paso del patrón Orquestador-Trabajador para agentes IA autónomos en producción.

Los sistemas multi-agente ya no son ciencia ficción ni papers académicos. Son la realidad de la automatización en 2026.

Según el informe “State of AI Agents” de Databricks (basado en datos anonimizados de más de 20.000 clientes, incluyendo el 60% del Fortune 500), los flujos de trabajo multi-agente crecieron un 327% en solo cuatro meses. Y Gartner predice que para 2028, el 33% del software empresarial incorporará IA agéntica, frente a menos del 1% en 2024.

¿Qué significa esto para ti? Que si estás construyendo automatizaciones con un solo workflow lineal (Trigger → Acción → Acción), te estás quedando atrás. Este artículo te enseña, paso a paso, cómo construir sistemas multi-agente en n8n usando la última versión (v2.8, febrero 2026) y el stack completo de herramientas que usamos en producción.

¿Qué es un sistema multi-agente?

Un sistema multi-agente es una arquitectura donde múltiples agentes de IA especializados colaboran para resolver una tarea compleja. En lugar de tener un solo workflow monolítico que lo hace todo, divides la lógica en agentes independientes, cada uno experto en una función concreta.

Ejemplo del mundo real: Cuando llega un nuevo lead a tu CRM, en vez de un workflow de 100 nodos que intenta hacer todo:

- Un Agente Investigador busca información de la empresa en LinkedIn y su web.

- Un Agente Analista evalúa si el lead encaja con tu perfil de cliente ideal.

- Un Agente Redactor genera un email personalizado basado en el análisis.

- Un Agente Manager (el orquestador) coordina todo, evalúa los resultados y decide el siguiente paso.

Cada agente es un workflow pequeño, reutilizable y fácil de depurar.

El problema: ¿Por qué los workflows lineales no funcionan para agentes IA?

Cada vez que un agente de IA “piensa” (razona sobre un problema, itera en un bucle, reintenta una tarea), consume recursos de ejecución. Esto crea tres problemas fundamentales:

1. El coste se dispara en plataformas serverless

| Plataforma | Modelo de facturación | Coste por “pensamiento” |

|---|---|---|

| Make.com | 1 crédito por acción (desde $9/mes para 10.000 créditos) | Un agente que itera 10 veces en un bucle consume 10 créditos |

| Zapier | 1 tarea por acción (desde $29.99/mes para 750 tareas) | Las mismas 10 iteraciones = 10 tareas consumidas |

| n8n Cloud | 1 ejecución por workflow completo (desde €24/mes para 2.500 ejecuciones) | Solo 1 ejecución, sin importar cuántos nodos internos ejecute |

Punto clave: n8n cobra por ejecución de workflow completa, no por paso individual. Esto hace que los bucles y la auto-corrección de agentes sean dramáticamente más baratos.

2. Los timeouts matan tus agentes

Un agente de investigación realista necesita tiempo para:

- Navegar varias páginas web (30-60 segundos cada una)

- Procesar la información con un LLM (5-15 segundos por llamada)

- Iterar si el resultado no es satisfactorio

Timeouts por plataforma:

- Make.com / Zapier: Las funciones serverless típicamente cortan entre 30 segundos y 5 minutos.

- n8n Cloud Starter: Timeout máximo de 5 minutos.

- n8n Cloud Pro: Timeout de hasta 40 minutos.

- n8n Self-hosted / AIBuildr: Sin límite de timeout. Tu agente puede tardar 20 minutos en investigar sin que nadie le corte.

3. No hay memoria entre ejecuciones

Un agente sin memoria es una calculadora. Si tu agente de soporte no recuerda la conversación de hace 5 minutos con el mismo cliente, la experiencia es horrible. Las plataformas serverless no ofrecen memoria persistente integrada — necesitas una base de datos vectorial como Qdrant para dotar a tus agentes de “memoria a largo plazo”.

El Stack Definitivo: n8n + Flowise + Qdrant

Para construir sistemas multi-agente en producción, necesitas tres capas:

1. Las Manos — n8n (v2.8+)

n8n es el motor de orquestación. Conecta APIs, mueve datos, gestiona disparadores y coordina la comunicación entre agentes.

Desde la versión 1.103, n8n incluye el nodo AI Agent Tool, que permite anidar agentes como herramientas dentro de otros agentes, todo en un mismo canvas. En la versión actual (v2.8, febrero 2026), las capacidades de IA son de primera clase: nodos nativos para OpenAI, Anthropic (Claude), Google Gemini y modelos locales vía Ollama.

¿Por qué n8n y no otro orquestador?

- Cobro por ejecución completa, no por paso: los bucles de agentes son gratis.

- Código abierto (fair-code): puedes autoalojarlo sin límites de ejecución.

- +400 integraciones nativas.

- Paradigma “publish vs save” (desde v2.0): puedes editar workflows en borrador sin afectar producción.

2. El Cerebro — Flowise

Flowise te permite construir cadenas de LLM complejas de forma visual: gestiona el contexto, el prompt engineering y RAG (Retrieval-Augmented Generation) de forma mucho más sofisticada que los nodos de LLM nativos de n8n.

La sinergia: n8n llama a Flowise vía API cuando un agente necesita “pensar” (razonar sobre datos, generar texto, tomar una decisión). Flowise procesa la solicitud con el LLM y devuelve la respuesta a n8n, que continúa la orquestación.

3. La Memoria — Qdrant

Qdrant es una base de datos vectorial open-source que proporciona memoria semántica a largo plazo a tus agentes. Permite que “recuerden” conversaciones pasadas, documentos internos o políticas de empresa sin necesidad de re-leerlos en cada ejecución.

Sin memoria vectorial, cada vez que un agente se enfrenta a una pregunta sobre tu producto, necesita procesar toda la documentación desde cero. Con Qdrant, el agente busca semánticamente las secciones relevantes y responde en milisegundos.

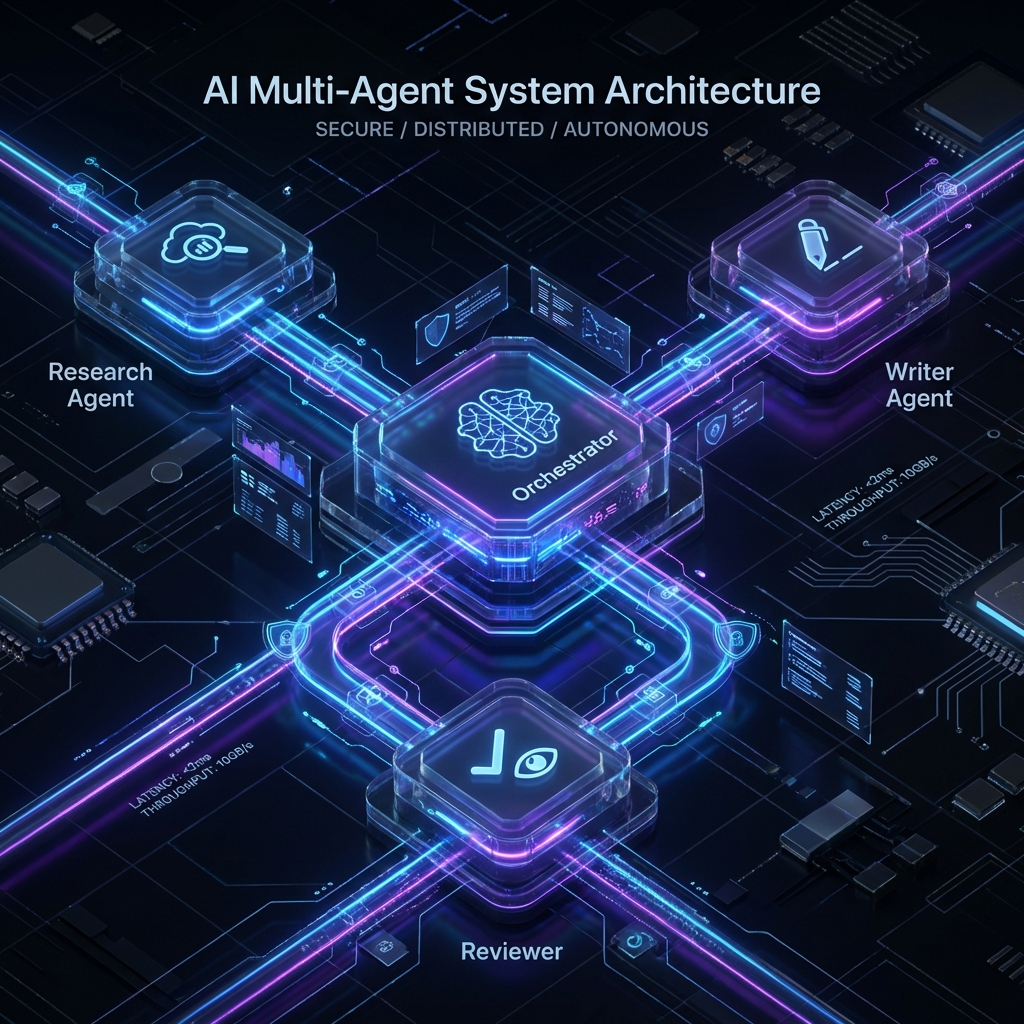

La Arquitectura: Patrón Orquestador-Trabajador

La clave para construir sistemas multi-agente robustos es desacoplar la lógica. No puedes tener un “mega-workflow” de 500 nodos. Necesitas una jerarquía clara.

El Orquestador (Manager)

Es el agente central. No hace el trabajo operativo. Sus funciones son:

- Recibir el objetivo o input inicial.

- Descomponer el objetivo en sub-tareas.

- Delegar cada sub-tarea al Agente Especialista correspondiente.

- Evaluar los resultados y decidir si la tarea está completa o necesita otra iteración.

En n8n, el Orquestador se implementa como un workflow principal que usa el nodo AI Agent o Execute Workflow para llamar a los Workers.

Los Agentes Especialistas (Workers)

Son workflows pequeños y enfocados que hacen una sola cosa muy bien:

- Researcher Agent: Navega URLs, extrae información, hace scraping.

- Writer Agent: Genera textos con tono y estilo específicos.

- Analyst Agent: Evalúa datos y produce informes estructurados.

- Coder Agent: Genera, valida o depura código.

Cada Worker expone un Webhook como interfaz de entrada y devuelve el resultado vía Respond to Webhook en formato JSON.

Tutorial: Construye Tu Primer Sistema Multi-Agente en n8n

Vamos a construir un sistema de cualificación de leads automatizado con tres agentes. Este tutorial asume que tienes n8n v2.x o superior.

Paso 1: El Agente Investigador (Worker)

Crea un nuevo workflow llamado Worker: Investigador.

- Trigger: Nodo

Webhookconfigurado para recibir un JSON con el campocompany_url. - Scraping: Nodo

HTTP Requestpara obtener el contenido de la web del lead. - Análisis con LLM: Nodo

AI Agentconectado a un modelo de lenguaje (OpenAI GPT-4o, Anthropic Claude, o un modelo local vía Ollama). El prompt instruye al agente a extraer: sector, tamaño de empresa, productos/servicios principales y señales de compra. - Respuesta: Nodo

Respond to Webhookque devuelve un JSON estructurado con los datos extraídos.

Paso 2: El Agente Evaluador (Worker)

Crea un workflow Worker: Evaluador.

- Trigger: Nodo

Webhookque recibe el JSON del investigador + los criterios de tu ICP (Ideal Customer Profile). - Evaluación: Nodo

AI Agentque compara los datos de la empresa con tu ICP y genera una puntuación (1-10) con justificación. - Respuesta: Devuelve la puntuación, la justificación y una recomendación (

contactar,nutrir,descartar).

Paso 3: El Agente Redactor (Worker)

Crea un workflow Worker: Redactor.

- Trigger: Nodo

Webhookque recibe los datos del investigador y la evaluación. - Generación: Nodo

AI Agentcon un prompt que genera un email comercial personalizado basado en el análisis. Usa un modelo potente (GPT-4o, Claude 3.5 Sonnet) para la calidad de escritura. - Respuesta: Devuelve el email en formato texto listo para enviar.

Paso 4: El Orquestador (Manager)

Este es el workflow principal que coordina todo:

- Trigger: Un evento en tu CRM (nuevo lead), un formulario web o un webhook manual.

- Llamada al Investigador: Nodo

HTTP Requestal webhook del Worker Investigador. Espera la respuesta. - Llamada al Evaluador: Pasa los datos del investigador al Worker Evaluador.

- Decisión: Un nodo

Switchevalúa la recomendación:- Si es

contactar→ llama al Worker Redactor → envía el email por Gmail/SMTP. - Si es

nutrir→ añade al lead a una secuencia de email marketing. - Si es

descartar→ actualiza el CRM y registra la razón.

- Si es

Pro Tip (AIBuildr): Cuando todos los Workers corren en el mismo Docker network (como en AIBuildr), las llamadas entre webhooks internos tienen latencia cercana a cero — la comunicación es instantánea.

Casos de uso reales para sistemas multi-agente

1. Pipeline de creación de contenido

Un equipo de agentes que investiga un tema, redacta un borrador, lo revisa gramaticalmente y lo publica en tu CMS. Todo sin intervención humana.

2. Soporte técnico inteligente

Un agente de triaje clasifica los tickets entrantes. Un agente de documentación busca en tu base de conocimiento (vía Qdrant). Un agente de respuesta genera la respuesta personalizada. Un agente de escalado decide si el caso necesita atención humana.

3. Análisis financiero automatizado

Un agente extrae datos de informes financieros (PDFs). Otro los normaliza y calcula ratios. Un tercero genera un informe ejecutivo con recomendaciones.

¿Por qué AIBuildr para sistemas multi-agente?

AIBuildr te despliega el stack completo (n8n + Flowise + Qdrant) en un VPS dedicado. Las ventajas concretas para sistemas multi-agente:

- Sin timeouts: Tus agentes pueden ejecutarse durante 20+ minutos sin que nadie corte la conexión. Esto es imposible en plataformas serverless.

- Ejecuciones ilimitadas: Al ser n8n self-hosted, no pagas por ejecución. Un agente que itera 50 veces en un bucle de auto-corrección no cuesta nada extra.

- Memoria integrada: Qdrant viene preconfigurado junto a tu n8n. Tus agentes tienen memoria semántica desde el día uno, sin pagar suscripciones adicionales a Pinecone o Weaviate.

- Modelos locales (IA Híbrida): Puedes conectar tu PC local con Ollama a tu n8n en la nube usando un túnel seguro (ngrok/Cloudflare Tunnel). Usa tu propia GPU para el trabajo pesado y el servidor en la nube para la disponibilidad 24/7.

- Red interna Docker: Los agentes se comunican entre sí con latencia cero al estar en el mismo Docker network.

Preguntas frecuentes

¿Qué modelo de IA es mejor para sistemas multi-agente en n8n?

Depende del rol del agente. Recomendamos usar modelos diferentes según la tarea para optimizar coste y calidad:

- Orquestador/Manager: Un modelo potente como GPT-4o o Claude 3.5 Sonnet, ya que necesita razonar sobre qué pasos seguir.

- Workers de investigación: Un modelo más económico como GPT-4o-mini o Claude Haiku, suficiente para extraer y resumir información.

- Workers de redacción: Un modelo de alta calidad como Claude 3.5 Sonnet, que sobresale en calidad de escritura.

¿Cuántos agentes puedo ejecutar simultáneamente?

En n8n Cloud Starter, 5 ejecuciones concurrentes. En n8n Cloud Pro, 20 ejecuciones concurrentes. En n8n self-hosted (como AIBuildr), el límite lo define la capacidad de tu servidor — típicamente 50+ agentes simultáneos sin problemas.

¿Necesito saber programar para construir sistemas multi-agente?

No necesariamente. n8n es una plataforma visual donde la mayor parte de la lógica se construye arrastrando nodos. Sin embargo, para personalización avanzada (procesamiento de datos complejos, integraciones custom), conocimientos básicos de JavaScript son muy útiles.

¿Es mejor usar el nodo AI Agent Tool o workflows separados con webhooks?

Ambos enfoques son válidos:

- AI Agent Tool (desde n8n v1.103): Ideal cuando quieres todo en un solo canvas. Más fácil de visualizar y depurar para sistemas con 2-4 agentes.

- Webhooks entre workflows: Mejor para sistemas más grandes (5+ agentes) donde quieres reutilizar Workers entre diferentes orquestadores. También facilita el desarrollo en equipo.

¿Cuál es la versión mínima de n8n para sistemas multi-agente?

El nodo AI Agent Tool se introdujo en la versión 1.103 de n8n. La versión actual es la v2.8 (febrero 2026), que incluye mejoras significativas en IA: nodos nativos para OpenAI, Anthropic, Google Gemini, trazado de ejecución mejorado y el paradigma de publicación vs. guardado.

Conclusión

La era de “conectar apps” ha terminado. Estamos en la era de gestionar equipos de agentes IA.

Los datos lo confirman: los flujos multi-agente crecieron un 327% en cuatro meses según Databricks, y Gartner predice que un tercio del software empresarial incorporará IA agéntica para 2028. No es una moda — es el nuevo paradigma.

La pregunta es: ¿Vas a pagar por cada pensamiento de tus agentes en una plataforma serverless, o vas a ser dueño de su infraestructura?